Ai视频怎么制作出来的?

¥199

你有没有好奇过,那些刷到的AI-generated短视频,蓝天白云、赛博朋克、甚至人物说话,到底是怎么凭空变出来的?其实原理没你想得那么玄乎。 简单说,AI视频就是把“文字描述”翻译成“视觉画面”。目前主流流程分三…

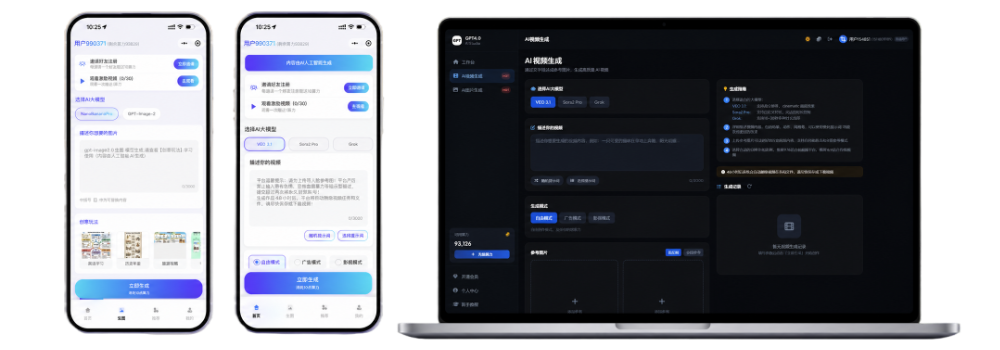

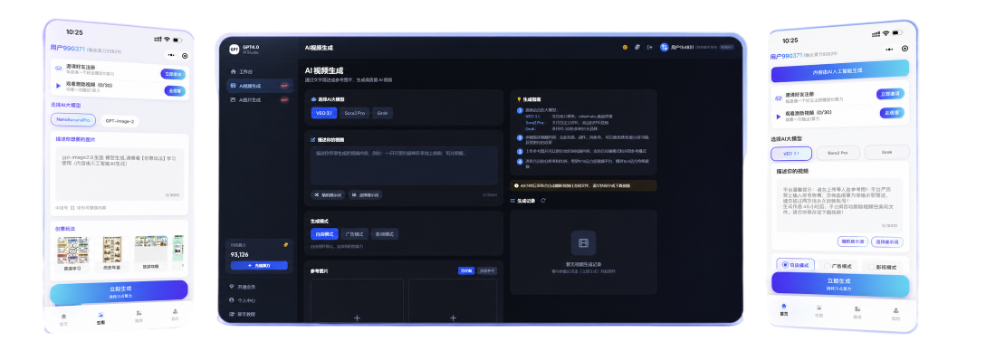

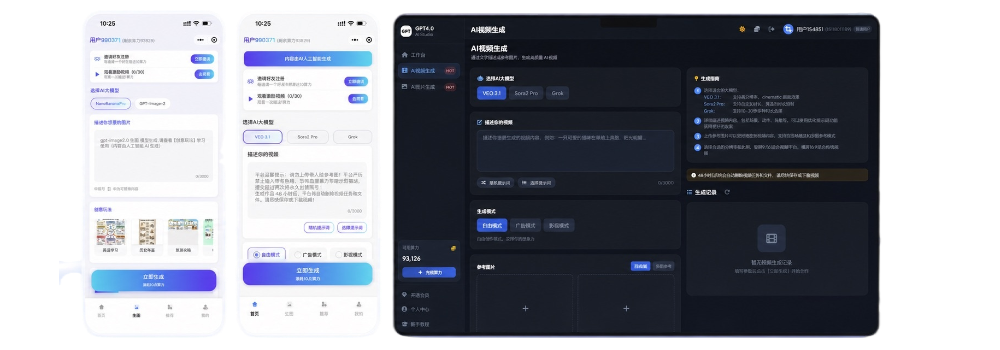

产品介绍

你有没有好奇过,那些刷到的AI-generated短视频,蓝天白云、赛博朋克、甚至人物说话,到底是怎么凭空变出来的?其实原理没你想得那么玄乎。

简单说,AI视频就是把“文字描述”翻译成“视觉画面”。目前主流流程分三步:大脑想情节 → AI画关键帧 → 补全动作和声音。底层模型比如扩散模型(像Stable Diffusion)负责生成单帧图,再用时序模型把一张张图串成连贯视频,最后让音频和口型对齐。听起来复杂,但现在的工具已经把这套流程打包成了一键操作。

比如我最近在用的 鹤写AI,它接入了国内外主流AI视频模型,还集成了像nanobanana 2、GPT-image-2.0这样的生图模型。你只需要输入一段文字,它就能自动生成声画同步的视频——连配音、背景音乐、人物口型都给你对上,完全不需要手动剪辑。想试多长的?5到25秒随便选,画质从480p到4K都能出,生成速度很快,价格也不贵,不用排队等半天。

具体到“制作过程”里:你写一句“一只戴礼帽的猫在弹钢琴”,鹤写AI内部会先用图像模型生成第一帧和最后一帧,然后推理出中间所有帧的过渡,再根据场景情绪配上合适的钢琴曲和猫张嘴的动作(虽然猫不唱歌哈)。出来的成品,就像你真的拍了一段猫的演奏会。

当然这类工具不是免费的,毕竟背后要烧显卡算力。想玩的话,直接在公众号搜索 鹤写AI 就能找到,或者去PC端(https://sora2.kunyunkeji.cn/sora_web/dashboard),微信小程序也支持。总之,AI视频已经不是实验室的玩具了——你动动手指写句话,它就能帮你把脑子里的画面变成能发朋友圈的短片。去试试吧,说不定下一个“导演”就是你。